KARAKURI LMについて

「KARAKURI LM」は、カラクリが開発する国産オープンモデルの中で最高性能の大規模言語(LLM)シリーズの総称です。

こちらではKARAKURI LMの特徴やローカルLLMを使いこなすTipsなど、生成AIのビジネス支援に役立つ情報を提供します。

低コスト×高性能を実現

「KARAKURI LM」は、カラクリが開発する大規模言語モデル(LLM)シリーズの総称です。日本のAI技術の発展のためにオープンモデルとして公開しています。- 国産オープンモデルで最高性能を獲得した700億パラメータLLM「KARAKURI LM 70B v0.1」

- 世界で初めてAWS TrainiumでMoEモデルの学習に成功した「KARAKURI LM 8x7B Chat v0.1」

- 国産モデルで初めてAIエージェントとして使える「KARAKURI LM 8x7B Instruct v0.1」

質の高いデータ作成

「学習データの品質=AIの出力精度」の中、LLM開発のデータ作成を委託している会社がほとんどです。カラクリはカスタマーサポートの経験のある社員やLLMの開発を行うリサーチャーたちが自らデータを作成し、高品質なデータを揃えています。

学習コスト50%削減

.png?width=294&height=196&name=%E5%90%8D%E7%A7%B0%E6%9C%AA%E8%A8%AD%E5%AE%9A%E3%81%AE%E3%83%87%E3%82%B6%E3%82%A4%E3%83%B3%20(50).png)

NVIDIAのGPUと比較するとトレーニングコストを50%削減できるAWS Tranium。その活用においてカラクリは初めてMoEモデルの学習を成功させるなど世界トップレベルの技術を誇ります。

オープンモデル活用

LLMの事前学習は通常、数百億円のコストが発生します。カラクリはMeta社のLlamaや東京工業大学のSwallowなどのオープンなべースモデルに継続事前学習や事後学習を行うことで、低コストで高性能なモデルを実現しています。

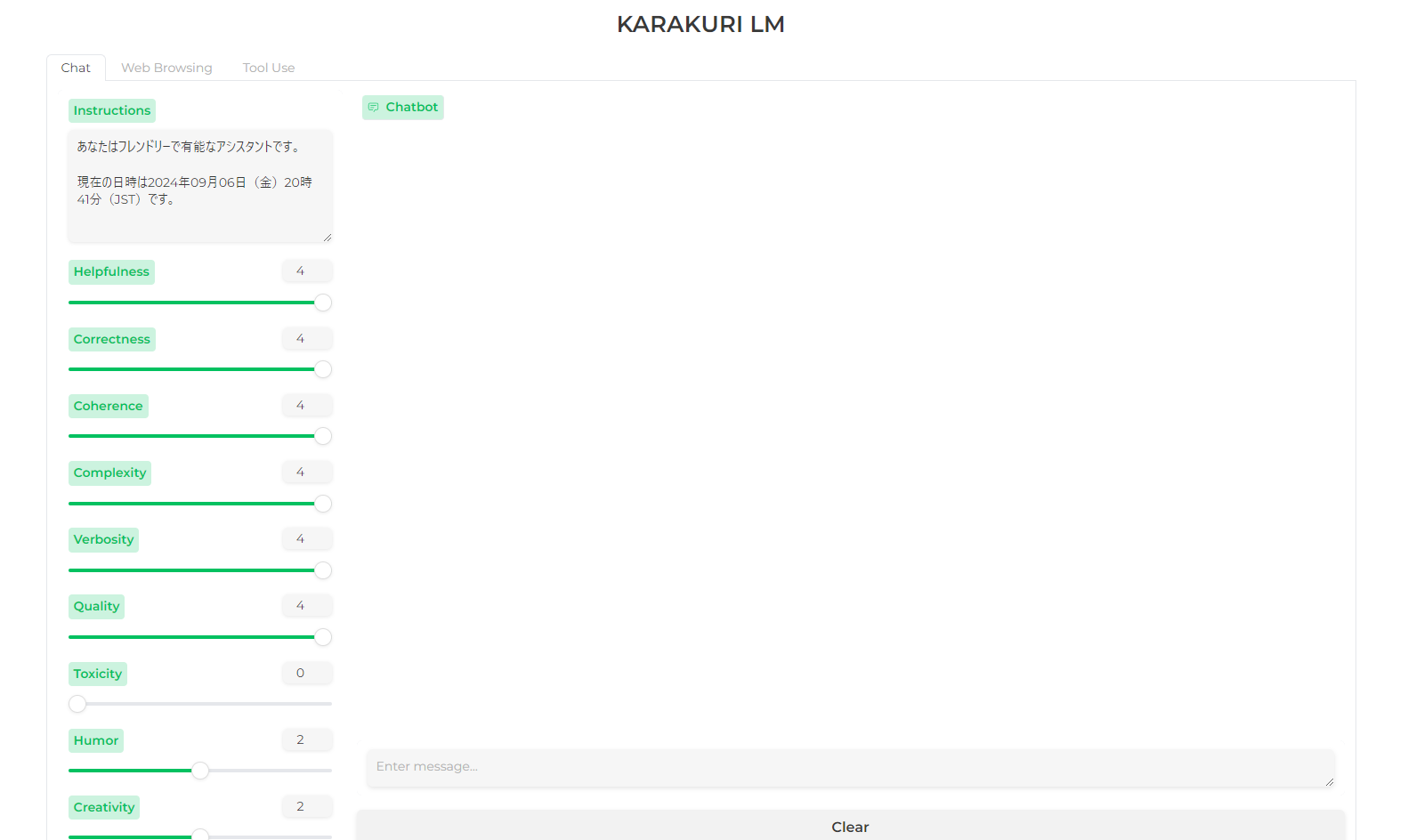

国内唯一 “9つのパラメーター設定 ”

9つのスコア付けで学習・出力の精度をあげる学習方法

KARAKURI LMはSteerLMと呼ばれる特殊な学習方法を用いています。それによって、9つのパラメーター(使用するときに変更できる数値)の設定が可能です。出力時にパラメーターを変えることで、用途にあった出力を得ることができます。

多くの大規模言語モデルは学習データのラベル付けを「良い」「悪い」の2軸で設定することが多い中、KARAKURI LMは「Helpfulness」「Correctness」「Coherence」など9つのスコアでデータを学習させており、それによって少ないデータでも高精度な出力を可能にしています。

大手企業が求める3要素『セキュリティ』『インテグレーション』『カスタマイズ』に強いモデルです。

『セキュリティ』

各社のプライベートクラウドやオンプレのシステム内に構築可能です。ハイエンドなPCであればローカルでの実行も可能。

『インテグレーション』

LLMをシステムに組み込む際に使われるRAGやFunction callingに日本語モデルでは唯一対応しており、AIエージェントとしても使用可能。

『カスタマイズ』

各企業の情報を学習したモデルを作成でき、特にAWSの生成AI専用チップを使うことで数十万円~という圧倒的低コストを実現。特化型軽量モデルの作成も対応可能。

シリコンバレーへ留学後、東京大学大学院へ進学。在学中に機械学習の社会実装を推進するため、2016年10月カラクリ株式会社を共同創業。東京大学大学院博士卒。

CPO中山智文 コメント

「KARAKURI LM」をオープンモデルとして公開した際、「なぜするのか?」というご質問をよく頂きました。その答えは2つあります。1つはカラクリの技術力を公平に評価していただきたいからです。多くの企業がモデルをクローズドにしており、実際にどのような評価を行い、どのような精度なのかもわからない状態で、「AI」を開発していることを謳っています。まだまだ駆け出しのスタートアップであるカラクリが信用していただくためには、オープンにすることで多くの技術者に評価していただくことが重要だと考えました。

もう1つは社会の知を拡げていくことに貢献したいという想いがあるからです。カラクリは「今までにないカラクリで世の中を豊かに」というミッションを掲げて創業した会社です。当時はR&Dチームの全員が東京大学の大学院でのAI関連の研究を行っているメンバーでした。「巨人の肩の上に立つ」という言葉がありますが、AIやLLMの研究はまさにそのようなものだと思っています。私たちのモデルも多くの先人たちの研究の上に成り立っており、そこにいくつかの「今までにないカラクリ」を加えたことで高性能なモデルを実現することができました。その知見をまた社会に還元し、AGIやASI、ひいては豊かな社会の実現に少しでも貢献していきたい、そういう思いでモデルやノウハウの公開に踏み切った次第です。

カラクリはこれからも「今までにないカラクリ」を作り続け、オープンマインドと技術を持って「豊かな社会」の実現をしていきたいと思います。

公開している「KARAKURI LM」の研究開発で得たノウハウや最新情報などを技術ブログとして公開しております。

2024/9/6 【KARAKURI LM 10本ノック】#5 カラクリ LM でエージェントを構築してみよう

2024/9/2 TrainiumでLLMを学習してInferentiaにデプロイする

2024/8/22 【KARAKURI LM 10本ノック】番外編 Chrome内蔵のローカルLLMで「どこでもCopilot」を作ってみた

2024/8/8 【KARAKURI LM 10本ノック】#3 LLM学習時のGPU消費量

2024/7/24 【KARAKURI LM 10本ノック】#2 KARAKURI LM ならではの機能、属性パラメータ(SteerLM)

2024/6/28 【KARAKURI LM 10本ノック】#1 KARAKURI LM を数クリックで動かしてみよう

2024/5/20 AWS TrainiumでMoEを学習する